Hoe intra-logistiek optimaliseren om Industry 4.0-toeleveringsketens te stroomlijnen en te versnellen - Deel twee van twee

Bijgedragen door De Noord-Amerikaanse redacteurs van DigiKey

2023-09-22

In deel 1 van deze serie over intra-logistiek werden problemen besproken met betrekking tot de manier waarop autonome mobiele robots (AMR's) en automatisch geleide voertuigen (AGV's) worden gebruikt op systeemniveau voor het implementeren van intra-logistiek en het snel en veilig verplaatsen van materialen zoals dat nodig is. Dit artikel richt zich op use cases en hoe AMR's en AGV's sensors gebruiken om items te identificeren en te volgen, hoe machine learning (ML) en kunstmatige intelligentie (AI) materiaalidentificatie, verplaatsing en levering van materialen in magazijnen en productiefaciliteiten ondersteunen.

Intra-logistiek (interne logistiek) maakt gebruik van autonome mobiele robots (AMR's) en automatisch geleide voertuigen (AGV's) om materialen efficiënt te verplaatsen in Industry 4.0 magazijnen en productiefaciliteiten. Om toeleveringsketens te stroomlijnen en te versnellen, moeten intra-logistieke systemen de huidige locatie van het materiaal kennen, de beoogde bestemming van het materiaal en het veiligste, meest efficiënte pad voor het materiaal om de bestemming te bereiken. Deze gestroomlijnde navigatie vereist een verscheidenheid aan sensors.

In intra-logistieke oplossingen gebruiken AGV's en AMR's sensors om hun situationeel bewustzijn te vergroten. Arrays van sensors bieden veiligheid voor personeel in de buurt, bescherming van andere apparatuur en efficiënte navigatie en lokalisatie. Afhankelijk van de toepassingsvereisten kunnen sensortechnologieën voor AMR's bestaan uit contactsensoren zoals eindschakelaars ingebouwd in bumpers, 2D- en 3D-lichtdetectie en afstandsbepaling (LiDAR), ultrasone sensors, 2D en stereocamera's, radar, encoders, traagheidsmeeteenheden (IMU's) en fotocellen. Voor AGV's kunnen sensors bestaan uit magnetische, inductieve of optische lijnsensors, maar ook uit eindschakelaars ingebouwd in bumpers, 2D LiDAR en encoders.

Het eerste artikel in deze serie gaat over hoe AMR's en AGV's worden gebruikt op systeemniveau voor het implementeren van intra-logistiek en het efficiënt verplaatsen van materialen.

Dit artikel richt zich op sensorfusie en hoe AMR's en AGV's combinaties van sensoren plus AI en ML gebruiken voor lokalisatie, navigatie en operationele veiligheid. Het begint met een kort overzicht van veelvoorkomende sensors in AGV's, onderzoekt robotpositie en gelijktijdige locatie- en mapping (SLAM)-algoritmen met behulp van sensorfusie, bekijkt hoe SLAM-schattingen kunnen worden verbeterd met scan-naar-map matching en scan-naar-scan matching technieken, en sluit af met een blik op hoe sensorfusie bijdraagt aan een veilige werking voor AMR's en AGV's. DigiKey ondersteunt ontwerpers met een breed assortiment sensors en schakelaars voor robotica en andere industriële toepassingen in al deze gevallen.

Er is een reeks sensors en sensorfusie, AI, ML en draadloze connectiviteit nodig om autonome werking en veiligheid in AMR's te ondersteunen. Hoewel de prestatie-eisen voor AGV's lager zijn, zijn ze nog steeds afhankelijk van meerdere sensors voor een veilige en efficiënte werking. Er zijn twee overkoepelende categorieën sensors:

- Proprioceptieve sensors meten interne waarden van de robot zoals wielsnelheid, belasting, batterijlading enzovoort.

- Exteroceptieve sensors leveren informatie over de omgeving van de robot, zoals afstandsmetingen, locaties van oriëntatiepunten en obstakelidentificatie, zoals mensen die op het pad van de robot komen.

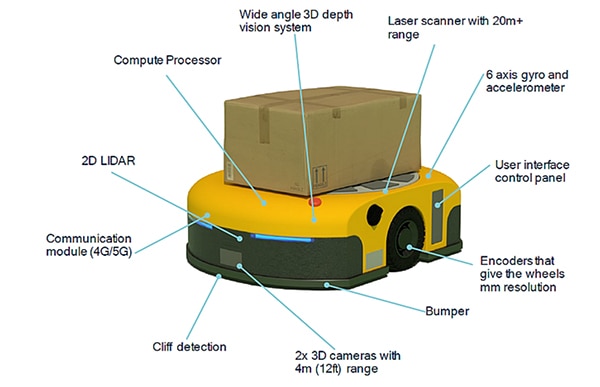

Sensorfusie in AGV's en AMR's is gebaseerd op combinaties van proprioceptieve en exteroceptieve sensors. Voorbeelden van sensors in AMR's zijn (Afbeelding 1):

- Laserscanner voor objectdetectie met een bereik van meer dan 20 meter (m)

- IMU met een gyroscoop en versnellingsmeter met 6 assen en soms een magnetometer

- Encoders met millimeterresolutie (mm) op de wielen

- Contactsensor zoals een microschakelaar in de bumper om de beweging onmiddellijk te stoppen als een onverwacht voorwerp wordt geraakt

- Twee vooruitkijkende 3D-camera's met een bereik van 4 m

- Neerwaarts gerichte sensor om de rand van een platform te detecteren (klifdetectie genoemd)

- Communicatiemodules om connectiviteit te bieden en optioneel Bluetooth angle of arrival (AoA) en angle of departure (AoD) detectie voor real-time locatiediensten (RTLS) of 5G Transmission Points/Reception Points (TRP) om een raster te plotten met centimeter nauwkeurigheid.

- 2D LiDAR om de nabijheid van obstakels voor het voertuig te berekenen

- Groothoek 3D-dieptezichtsysteem geschikt voor objectidentificatie en lokalisatie

- Krachtige rekenprocessor aan boord voor sensorfusie, AI en ML

Afbeelding 1: Voorbeeld van een AMR met de diversiteit en posities van de ingebouwde sensors. (Bron afbeelding: Qualcomm)

Afbeelding 1: Voorbeeld van een AMR met de diversiteit en posities van de ingebouwde sensors. (Bron afbeelding: Qualcomm)

Robothouding en sensorfusie

AMR-navigatie is een complex proces. Een van de eerste stappen is dat de AMR weet waar hij is en in welke richting hij kijkt. Die combinatie van gegevens wordt de robothouding genoemd. Het concept van houding kan ook worden toegepast op de armen en eindeffectoren van meerassige stationaire robots. Samenvoeging van sensors combineert de input van de IMU, encoders en andere sensors om de houding te bepalen. Het houding-algoritme schat de (x, y) positie van de robot en de oriëntatiehoek θ ten opzichte van de coördinaatassen. De functie q = (x, y, θ) definieert de houding van de robot. Voor AMR's heeft houdinginformatie verschillende toepassingen, waaronder:

- De houding van een indringer, zoals een persoon die dicht bij de robot komt, ten opzichte van een extern referentiekader of ten opzichte van de robot.

- De geschatte positie van de robot nadat deze gedurende een vooraf bepaalde tijd met een bepaalde snelheid heeft bewogen.

- Het berekenen van het snelheidsprofiel dat de robot nodig heeft om van de huidige positie naar een tweede positie te bewegen.

Houding is een voorgedefinieerde functie in verschillende ontwikkelomgevingen voor robotsoftware. Het pakket robot_pose_ekf is bijvoorbeeld opgenomen in het Robot Operating System (ROS), een open-source ontwikkelplatform. Robot_pose_ekf kan worden gebruikt om de 3D-houding van een robot te schatten op basis van (gedeeltelijke) posemetingen van verschillende sensors. Het gebruikt een uitgebreid Kalman-filter met een 6D-model (3D-positie en 3D-oriëntatie) om metingen van de encoder voor wiel odometrie, een camera voor visuele odometrie en de IMU te combineren. Aangezien de verschillende sensors met verschillende snelheden en latenties werken, vereist robot_pose_ekf niet dat alle sensorgegevens continu of gelijktijdig beschikbaar zijn. Elke sensor wordt gebruikt om een schatting van de houding te geven met een covariantie. Robot_pose-ekf identificeert de beschikbare sensorinformatie op elk moment en past zich dienovereenkomstig aan.

Sensorfusie en SLAM

Veel omgevingen waarin AMR's werken, bevatten variabele obstakels die van tijd tot tijd kunnen bewegen. Hoewel een basiskaart van de faciliteit nuttig is, is er meer nodig. Bij het verplaatsen in een industriële faciliteit hebben AMR's meer nodig dan informatie over de positie; ze maken ook gebruik van SLAM om efficiënt te kunnen werken. SLAM voegt real-time omgevingskaarten toe om navigatie te ondersteunen. Twee basisbenaderingen van SLAM zijn:

- Visuele SLAM die een camera koppelt aan een IMU

- LiDAR SLAM dat een lasersensor zoals 2D of 3D LiDAR combineert met een IMU

LiDAR SLAM kan nauwkeuriger zijn dan visuele SLAM, maar is over het algemeen duurder om te implementeren. Als alternatief kan 5G worden gebruikt om lokalisatie-informatie te leveren om visuele SLAM-schattingen te verbeteren. Het gebruik van privé 5G-netwerken in magazijnen en fabrieken kan ingebouwde sensors voor SLAM uitbreiden. Sommige AMR's implementeren nauwkeurige plaatsbepaling binnenshuis met behulp van 5G-transmissiepunten/ontvangstpunten (TRP) om een raster uit te zetten met een centimeter nauwkeurigheid op x-, y- en z-as.

Succesvolle navigatie is afhankelijk van het vermogen van een AMR om zich aan te passen aan veranderende omgevingselementen. Navigatie combineert visuele SLAM en/of LiDAR SLAM, overlay-technologieën zoals 5G TRP en ML om veranderingen in de omgeving te detecteren en constante locatie-updates te bieden. Sensorfusie ondersteunt SLAM op verschillende manieren:

- Voortdurende updates van het ruimtelijke en semantische model van de omgeving op basis van input van verschillende sensors met behulp van AI en ML

- Identificatie van obstakels, waardoor padplanningsalgoritmen de nodige aanpassingen kunnen maken en het meest efficiënte pad door de omgeving kunnen vinden

- Implementatie van het padplan, waarbij real-time besturing nodig is om het geplande pad te wijzigen, inclusief de snelheid en richting van de AMR, als de omgeving verandert.

Wanneer SLAM niet genoeg is

SLAM is een essentieel hulpmiddel voor efficiënte AMR-navigatie, maar SLAM alleen is onvoldoende. Net als houdingsalgoritmen wordt SLAM geïmplementeerd met een uitgebreid Kalman-filter dat geschatte waarden levert. De door SLAM geschatte waarden breiden de positiegegevens uit en voegen onder andere lineaire en rotatiesnelheden en lineaire versnellingen toe. SLAM-schatting is een proces in twee stappen; in de eerste stap worden voorspellingen samengesteld op basis van interne sensoranalyses, gebaseerd op de natuurkundige bewegingswetten. De resterende stap in de SLAM-schatting vraagt om metingen van externe sensors om de initiële schattingen te verfijnen. Dit proces in twee stappen helpt bij het elimineren en corrigeren van kleine fouten die zich na verloop van tijd kunnen opstapelen en significante fouten kunnen veroorzaken.

SLAM is afhankelijk van de beschikbaarheid van sensorinputs. In sommige gevallen werkt relatief goedkope 2D LiDAR niet, bijvoorbeeld als er zich geen objecten in de directe zichtlijn van de sensor bevinden. In die gevallen kunnen 3D-stereocamera's of 3D LiDAR de systeemprestaties verbeteren. 3D stereocamera's of 3D LiDAR zijn echter duurder en vereisen meer rekenkracht voor implementatie.

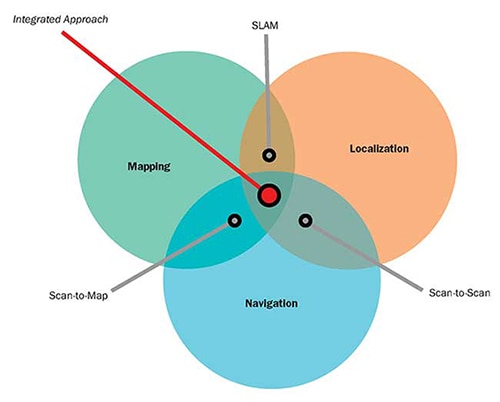

Een ander alternatief is het gebruik van een navigatiesysteem dat SLAM integreert met scan-naar-kaart matching en scan-naar-scan matching technieken die geïmplementeerd kunnen worden met alleen 2D-LiDAR-sensors (Afbeelding 2):

- Scan-to-kaart-matching gebruikt LiDAR-bereikgegevens om de positie van de AMR in te schatten door de afstandsmetingen te vergelijken met een opgeslagen kaart. De effectiviteit van deze methode hangt af van de nauwkeurigheid van de kaart. Er treedt geen drift op in de tijd, maar in repetitieve omgevingen kan dit leiden tot fouten die moeilijk te identificeren zijn, discontinue veranderingen in de waargenomen positie veroorzaken en moeilijk te elimineren zijn.

- Scan-naar-scan-matching gebruikt opeenvolgende LiDAR-bereikgegevens om de positie van een AMR tussen scans in te schatten. Deze methode levert bijgewerkte locatie- en pose-informatie voor de AMR onafhankelijk van een bestaande kaart en kan nuttig zijn tijdens het maken van kaarten. Het is echter een incrementeel algoritme dat in de loop van de tijd kan afwijken zonder dat de onnauwkeurigheden die de afwijking introduceert, kunnen worden geïdentificeerd.

Afbeelding 2: Scan-naar-kaart en scan-naar-scan-matchingalgoritmen kunnen worden gebruikt om de prestaties van SLAM-systemen aan te vullen en te verbeteren. (Bron afbeelding: Aethon)

Afbeelding 2: Scan-naar-kaart en scan-naar-scan-matchingalgoritmen kunnen worden gebruikt om de prestaties van SLAM-systemen aan te vullen en te verbeteren. (Bron afbeelding: Aethon)

Veiligheid vereist sensorfusie

Veiligheid is een belangrijk aandachtspunt voor AGV's en AMR's en er moet rekening worden gehouden met verschillende normen. Bijvoorbeeld American National Standards Institute / Industrial Truck Standards Development Foundation (ANSI/ITSDF) B56.5 - 2019, veiligheidsnorm voor bestuurderloze, automatisch geleide industriële voertuigen en geautomatiseerde functies van bemande industriële voertuigen, ANSI / Robotic Industrial Association (RIA) R15.08-1-2020 - norm voor industriële mobiele robots - veiligheidseisen, verschillende normen van de International Standards Organization (ISO) en andere.

Voor een veilige werking van AGV's en AMR's is sensorfusie nodig die veiligheidsgecertificeerde 2D LiDAR-sensors (soms veiligheidslaserscanners genoemd) combineert met encoders op de wielen. De 2D LiDAR ondersteunt tegelijkertijd twee detectieafstanden, kan een detectiehoek van 270° hebben en coördineert met de voertuigsnelheid die door de encoders wordt gerapporteerd. Wanneer een object wordt gedetecteerd in de verste detectiezone (tot op 20 m afstand, afhankelijk van de sensor), kan het voertuig indien nodig worden afgeremd. Als het object de dichtstbijzijnde detectiezone in de rijlijn binnengaat, stopt het voertuig met rijden.

Veiligheidslaserscanners worden vaak gebruikt in sets van 4, waarbij er één op elke hoek van het voertuig wordt geplaatst. Ze kunnen als één unit werken en rechtstreeks communiceren met de veiligheidscontroller op het voertuig. De scanners zijn beschikbaar en gecertificeerd voor gebruik in toepassingen van veiligheidscategorie 3, prestatieniveau d (PLd) en veiligheidsintegriteitsniveau 2 (SIL2) en zijn ondergebracht in een IP65-behuizing die geschikt is voor de meeste toepassingen, zowel binnen als buiten (Afbeelding 3). De scanners bevatten een ingang voor incrementele encoderinformatie van de wielen om sensorfusie te ondersteunen.

Afbeelding 3: 2D-LiDAR-sensors zoals deze kunnen worden gecombineerd met encoders op de wielen in een sensorfusiesysteem dat een veilige werking van AMR's en AGV's mogelijk maakt. (Bron afbeelding: Idec)

Afbeelding 3: 2D-LiDAR-sensors zoals deze kunnen worden gecombineerd met encoders op de wielen in een sensorfusiesysteem dat een veilige werking van AMR's en AGV's mogelijk maakt. (Bron afbeelding: Idec)

Conclusie

Intra logistiek ondersteunt snellere en efficiëntere toeleveringsketens in Industry 4.0-magazijnen en -fabrieken. AMR's en AGV's zijn belangrijke hulpmiddelen voor intra-logistiek om materiaal tijdig en veilig van plaats naar plaats te brengen. Samenvoeging van sensors is nodig om AMR- en AGV-functies te ondersteunen, waaronder het bepalen van de houding, het berekenen van SLAM-gegevens, het verbeteren van de navigatieprestaties met behulp van scan-naar-kaartmatching en scan-naar-scanmatching, en het waarborgen van de veiligheid voor personeel en objecten in de hele faciliteit.

Disclaimer: The opinions, beliefs, and viewpoints expressed by the various authors and/or forum participants on this website do not necessarily reflect the opinions, beliefs, and viewpoints of DigiKey or official policies of DigiKey.